TinyRobotBench 🦾💡

2024, May 22

LLM guides robot operations

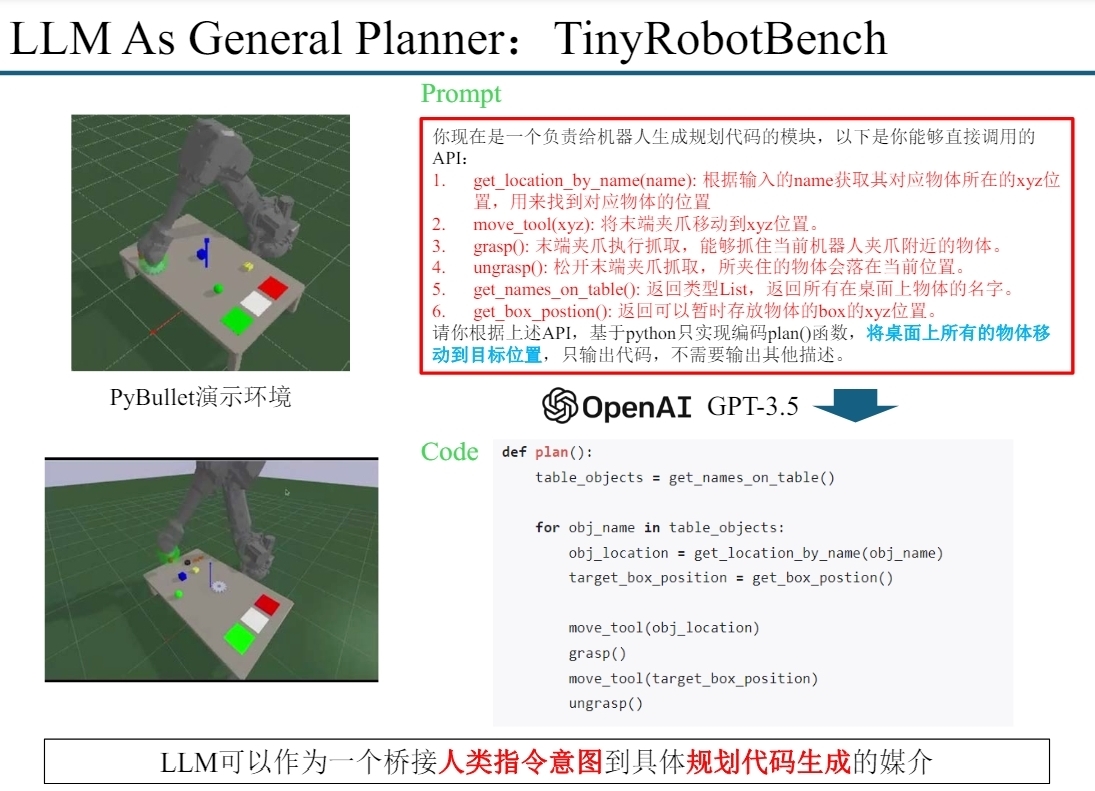

封面图源于 Yunlong Dong (@东林钟声) 在Talk “具身智能基础技术路线” 中的对其博文“Robotics+LLM系列TinyRobotBench开篇”的引述。

我在网上冲浪时看到一篇有趣的文章

该文章描述了一个LLM指导Robot做任务的项目,大概内容就是:

- 针对特定任务维护一个机器人高层(High-Level)API,主要包括感知(定位物体、识别物体等)、控制(移动、抓取)等

- 构建Prompt,描述目标并且指定当前可用的机器人操作API,喂给LLM

- 将LLM生成的代码部署机器人上

虽然这个项目很Toy,但我觉得它对于一个Embodied AI初学者来说很有用,有助于打通LLM指导Robot做任务的大体流程。你知道的,现在 LLM + Robotics 的套路在Embodied AI社区非常火,变着花样发文章。

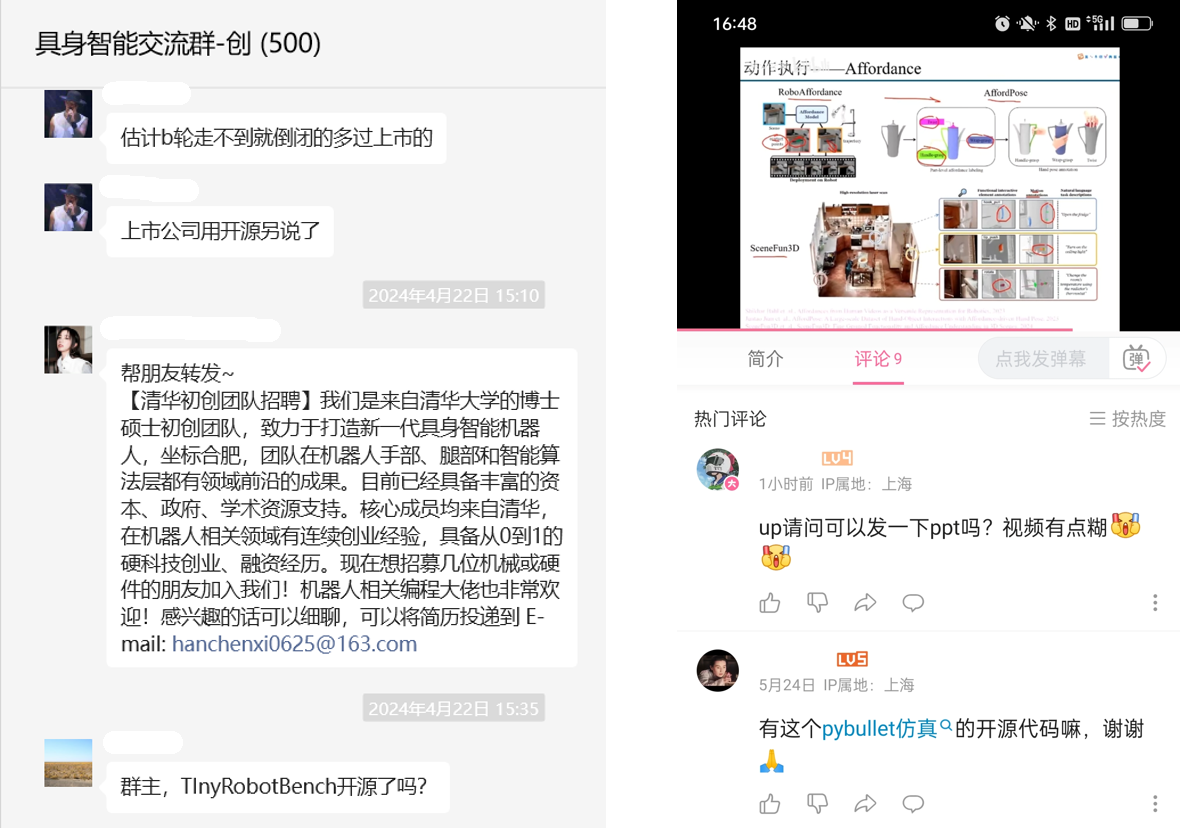

但是,该项目并没有开源代码

(大概是作者认为它太Toy了,没有开源的意义),然后我还在很多地方看到有人在向作者求代码,但作者并没有回复

于是我心血来潮将该项目复现,主要内容包括:

- 一套基本的机器人操作的API (based on sapien)

- 一个部署LLM,发布LLM API的工具 (based on HF transformers)

- 一个ChatBot Web UI (based on chainlit & langchain, 支持RAG与Multi-Modal, 暂时对该项目没有什么用)

效果如下:

代码已上传至 GitHub:

假如真能起到一些帮助的话,还是蛮开心的哦😊~

(截止25/6/2024有3个Fork 9个⭐啦!开心开心开心,唔~~😝😝)